| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 스칼라 강좌

- 그라파나

- 스칼라

- play 강좌

- hyperledger fabric

- 파이썬 머신러닝

- 엔터프라이즈 블록체인

- 블록체인

- 안드로이드 웹뷰

- Hyperledger fabric gossip protocol

- Play2 로 웹 개발

- Play2

- 이더리움

- 파이썬

- akka 강좌

- Actor

- play2 강좌

- Akka

- 파이썬 강좌

- 플레이프레임워크

- Adapter 패턴

- 스위프트

- 하이브리드앱

- 하이퍼레저 패브릭

- 파이썬 데이터분석

- 스칼라 동시성

- CORDA

- 파이썬 동시성

- 주키퍼

- Golang

- Today

- Total

목록아마존 AWS & 클라우드 (5)

HAMA 블로그

AWS IoT, Kinesis Firehose, Athena , QuickSight 를 이용한 IoT 통찰

AWS IoT, Kinesis Firehose, Athena , QuickSight 를 이용한 IoT 통찰

IoT 에 대한 통찰을 길러보자. AWS IoT, Amazon Kinesis Firehose, Amazon Athena, and Amazon QuickSightby Ben Snively | on 22 DEC 2016 | Permalink | CommentsAWS IoT 보안이 제공되고, MQTT 와 HTTPS 프로토콜 기반으로 쉽게 디바이스와 연결할 수 있습니다. IoT 룰엔진은 끊임없이 들어오는 메세지를 처리하여 다른 AWS 서비스들에게 전달하여 상호 작용을 할 수 있습니다.Amazon S3 당신의 모든 데이터 (크던,작던)에 대해서 높은 신뢰성,보안성,확장성을 제공하는 객체 저장소이다. 99.99999999% 내구성을 갖도록 설계되었습니다.Amazon Kinesis Firehose Amazon Kin..

아마존 웹서비스 (AWS) 대략적 이용 가격

아마존 웹서비스 (AWS) 대략적 이용 가격

아마존 웹서비스 (AWS) 이용 가격 세부적으로는 요금계산기를 통해 알아보고 대충 머리속에 기억하고 있을만한 내용만 적어보았다. 여기서 나오는 가격은 모두 대략 이란 것을 명심하라. 각종 옵션에 따라 매우 달라진다. 정확한 계산을 위한 계산기는 여기 http://calculator.s3.amazonaws.com/index.html S3 (스토리지) - 일반적인 저장소로서 1TB 저장하는데 한달에 대략 5만원 (1기가당 50원) - 같은 리전에 있는 EC2 와 S3 간의 데이터 전송에는 전송 요금이 청구되지 않음.- Copy 요청을 통해 S3 지역에서 데이터를 전송한 경우 데이터 전송 요금이 청구되지 않음.- S3 에서 인터넷으로의 데이터 송신은 1TB 월당 대략 15만원 ( GB 당 150원 )- S3 ..

사물인터넷을 위한 빅데이터 처리를 위한 AWS ( IoT / 키네시스 / 람다 )

사물인터넷을 위한 빅데이터 처리를 위한 AWS ( IoT / 키네시스 / 람다 )

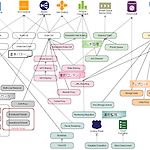

사물인터넷을 위한 빅데이터 처리를 위한 AWS 살펴보기 다양한 기기로 부터 거대하게 생산되는 스몰데이터들을 빠르고 정확하게 처리하기 위한 AWS 의 솔루션을 살펴보면 IoT / 키네시스 / 람다가 발견된다. 과연 이들이 무엇이고 어떻게 다른지 살펴본다.아직 본인도 개념이 많이 부족하기때문에 차츰 차츰 보완해나갈 예정이다. 먼저 다음 그림을 보고 대략 느낌을 받아보자~ (다양한 시나리오를 살펴보자)AWS IOT -> AWS 키네시스 -> Lamda 로 보내진다. 1. AWS IOT에서 데이터를 수집후 (룰엔진을 거칠수도 있고 안거칠수도 있고) 2-1. 데이터 그대로 S3 에 저장 또는 2-2.키네시스로 보내져서 분석한후에 스토리지에 저장. 1. AWS IOT에서 데이터를 수집후 (룰엔진을 거칠수도 있고 안..

내 환경 - 클라이언트 : windows 8.1- EC2 서버 : Ubuntu 14 http://theweak.tistory.com/52 http://behonestar.tistory.com/63 참고해서 했는데 안됬다. ㅜㅜ 왜 안될까 -.-a

AWS 클라우드 디자인 패턴 (CDP)

AWS 클라우드 디자인 패턴 (CDP)

아마존 웹 서비스 클라우드 디자인 패턴 설계 가이드 요약 기본패턴Snapshot패턴 (데이터 백업) Stamp 패턴 (서버 복제) Scale up 패턴 ( 동적 서버 사용 업 / 다운 ) OnDemand 디스크 패턴 ( 동적 디스크 용량 증감) 가용성 향상 패턴Multi-Server패턴 (서버이중화)Multi-DataCenter패턴 (데이터센터 레벨의 이중화)Floating IP패턴 (IP어드레스 동적 이동)Deep Health Check패턴 (시스템 상태 확인) 동적 컨텐츠 처리 패턴Scale Out패턴(서버 수의 동적 증감)Clone Server패턴(서버 클론)NFS Sharing 패턴 (공유 컨텐츠 이용)NFS Replica패턴 (공유 컨텐츠 복제)State Sharing 패턴 (상태 정보 공유)U..